Idioma

Python, Jupyter Notebook

Tipo de herramienta

Algoritmo

Licencia

Creative Commons Attribution 4.0

Versión

N/D

Colectivo de investigación SignLLM

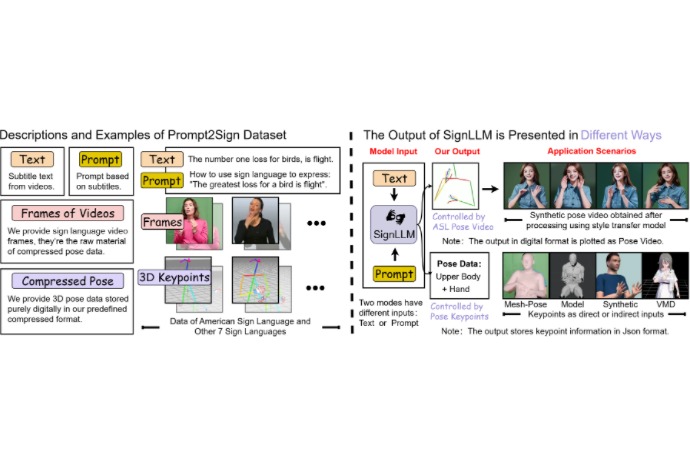

SignLLM es un modelo de lenguaje de gran tamaño diseñado para la producción de lenguaje de señas multilingüe. Ofrece dos modos, MLSF y Prompt2LangGloss, que generan gestos en lenguaje de señas a partir de textos y preguntas, utilizando un enfoque de aprendizaje por refuerzo para mejorar la calidad del entrenamiento. Para su desarrollo, se utilizó Prompt2Sign, un conjunto de datos que abarca el lenguaje de señas americano y otros siete lenguajes. Este conjunto estandariza la información al extraer poses de videos en un formato unificado, permitiendo que SignLLM logre un rendimiento destacado en diversas tareas de producción de lenguaje de señas.

SignLLM resuelve el problema de la generación de lenguaje de señas multilingüe a partir de texto, facilitando la comunicación inclusiva para personas sordas. Utiliza modos innovadores y aprendizaje por refuerzo para mejorar la calidad y eficiencia del entrenamiento, soportando ocho lenguajes de señas y estandarizando datos para un acceso más amplio.

SignLLM es un modelo de lenguaje diseñado para la producción multilingüe de lenguaje de señas. Funciona mediante dos modos, MLSF y Prompt2LangGloss, que generan gestos a partir de textos y preguntas. Utiliza aprendizaje por refuerzo para mejorar el entrenamiento, apoyado por el conjunto de datos Prompt2Sign, que estandariza información de poses de videos en ocho lenguajes de señas.

SignLLM resuelve el problema de la generación de gestos en lenguaje de señas a partir de textos de consulta y preguntas, facilitando la comunicación inclusiva. Utiliza un modelo de lenguaje grande multilingüe y un nuevo enfoque de aprendizaje por refuerzo para mejorar la calidad y eficiencia del entrenamiento en ocho lenguajes de señas.

Conéctese con el equipo de Código para el Desarrollo y descubra cómo nuestras herramientas de código abierto, cuidadosamente curadas, pueden apoyar a su institución en América Latina y el Caribe. Escríbanos para explorar soluciones, resolver dudas de implementación, compartir éxitos de reutilización o presentar una nueva herramienta. Escríbenos a [email protected]

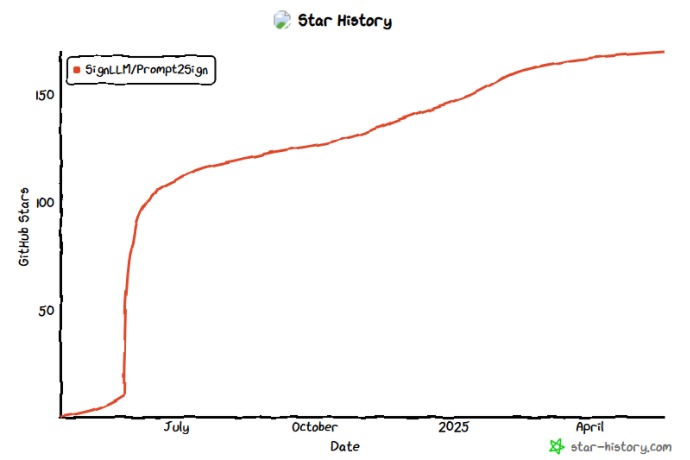

El modelo SignLLM ha ganado más de 160 estrellas en GitHub desde su lanzamiento, destacando el interés por la generación de lenguaje de señas multilingüe.

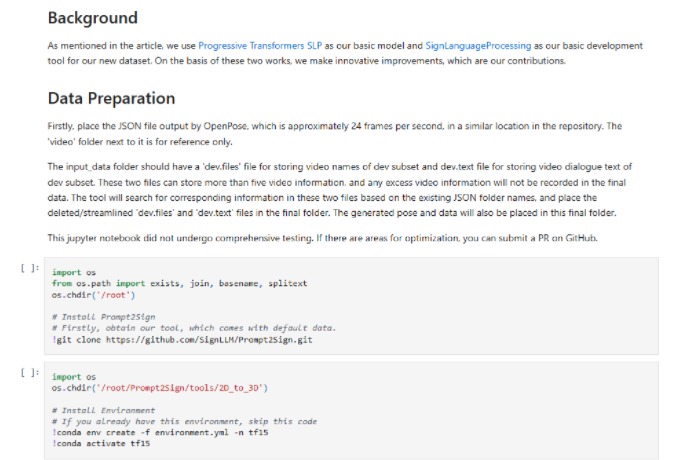

El notebook guía la preparación de datos desde archivos JSON de OpenPose, clonando el repositorio Prompt2Sign y configurando el entorno para generar poses desde videos de lenguaje de señas.

Prompt2Sign incluye textos, prompts, fotogramas de videos y poses 3D comprimidas en 8 lenguas de señas. SignLLM genera poses digitales desde texto o prompts, con salida en video sintético o modelos 3D.

Descripción, demo y materiales del proyecto.

Artículo técnico del enfoque Prompt2Sign.

Demostración del modelo generador de señas.